AI换脸一点不新鲜,几年前我们就在各种小视频网站看到各种换上明星的脸的小视频,当时都在感叹“科技改变生活!”

但近一年来,在各大模型的加持下,AI造假开始越来越猖獗,成为悬在我们每一个人头上的一把利剑,一不小心就利剑穿心!

前些天,外网还有位性感的日本女议员火了。

不过去深入了解之后就会发现,这位被围观的网传“日本议员”,的确是“有点东西”。

一句话形容:仪态端庄、文雅大方、身材火辣。

有人说她是厚生省劳动大臣,有人说她是新上任的外务省官员,也有人说她是日本带恶人山口组五代目的孙女,德川家康的后人……各种小道消息满天飞。

从没想过有一天,网友会对岛国的政治这么感兴趣,仅仅靠几张照片就能收获几十万甚至上百万的流量,彻底俘虏了全网的目光。

也有人在认真扒这个女议员的真实身份,毕竟穿着如此大胆,如果真的“身居高位”,未免反差也太离谱。

稍微去了解一下厚生劳动大臣的背景就会发现,这个职位是日本内阁中重要的组成部分,一般由执政党内的实力派议员担任。

真实情况就是,无论是厚生省还是外务省,过去还是现在,你都找不到这个日本女议员的存在。

日本现任外务大臣是林芳正

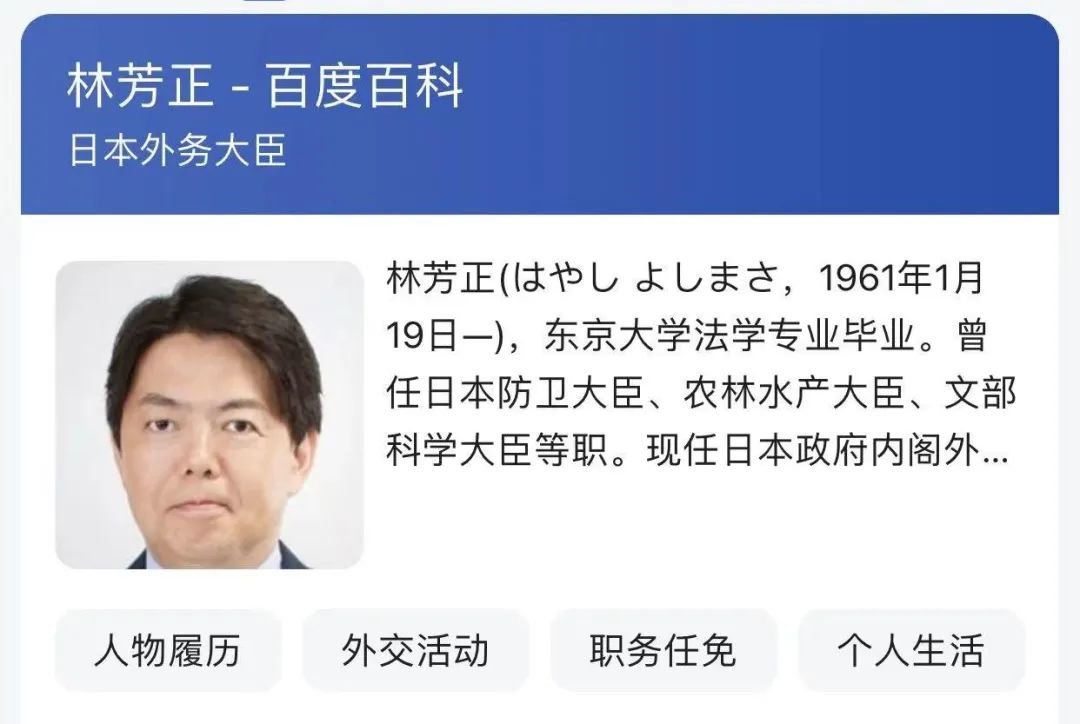

再回到一开始大家疯传的照片上,仔细溯源后会发现,原来这是一位经常发福利照片的博主,所制作的AI照片……

整个“日本议员”系列,不过是这位博主平时用AI创作的假照片,他还整过其他诸如“天气播报员”系列,无一例外都是专注于展示身材。

只不过这次因为内容过于反差和捏的角色看起来太真,才传播了出去。

在照片火了之后,这位福利博主还放出了更多AI创作的身材火辣“议员”,并调侃称,要真的成立一个党派……

为此应援的网友还不少。

听内参君一句劝,什么都喜欢,只会害了你。

回过头来看,即使AI创作的再真,但要是放在其他国家,“爆乳议员”绝对是一眼假的存在。

但这是总会给人“惊喜”的岛国,一开始没人会怀疑也很正常……

如果这样的AI照片做出来是给大家图一乐,网友们“上当”看看也就罢了。

可有些人用AI真心想骗人,那就实在很恐怖了!

9秒骗走132万

不知道大家是不是和我一样,碰到朋友发消息说借钱,在愿意借的情况下,一般会让对方发个语音或打个电话,甚至直接视频确认对方身份,这样才敢打钱过去。

但现在,这样的操作很有可能会翻车。

事情是这样的,今天早上我刷到了一个视频,一位网友演示他买到的“神奇软件”,能通过提前选定的视频,让对方看到任意的人。

一开始是一位露脸的美女,随后又换成了穿着露脐装的姑娘。

如果这两位是你的好朋友,说的话也是熟悉的声音,你会不会上当受骗?

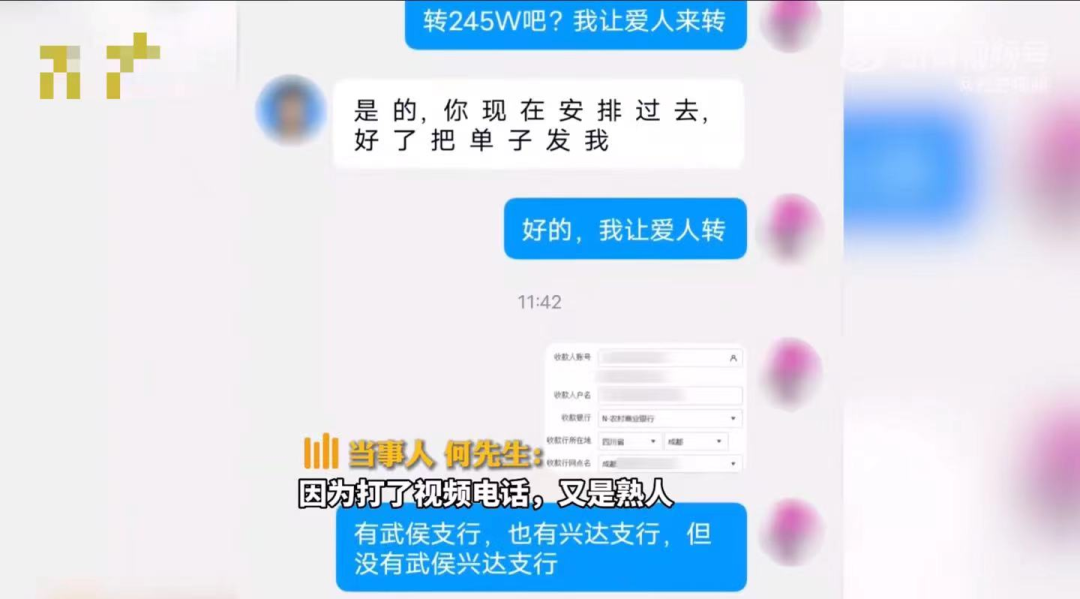

这并不是耸人听闻,财联社5月25日消息,安徽安庆一位何先生,9秒被AI换脸骗走132万。

当时,何先生接到熟人视频电话,让他帮忙转一笔账,才说了9秒钟,对方便称“在开会”迅速挂断了电话,还称“微信和电话不能说,加一下QQ”。

如果是微信聊天,那大家心里肯定犯嘀咕,但在视频聊天的情况下,何先生也没想太多,便转了钱过去:“因为打了视频电话,又是熟人,我就没多想,就转账了”。

发现被骗之后,何先生迅速报警,专案民警第一时间冻结相关账户,连夜赶赴北京市抓获3名涉诈嫌疑人,追回何先生被骗的132万元。

无独有偶,在这件事发生前不久,央视也报道了一起金额高达430万元的AI换脸诈骗,过程几乎差不多。

来自福建的郭先生是一家科技公司的法人代表。今年4月,他的好友突然通过微信视频联系他,称自己的朋友在外地竞标,需要430万元保证金,想借用郭先生公司的账户走账。

基于对好友的信任,加上已经视频聊天“核实”了身份,郭先生在10分钟内,先后分两笔把430万元转到了对方的银行账户上。

事后,郭先生拨打好友电话才得知被骗,原来骗子通过AI换脸和拟声技术,佯装好友对其实施诈骗。“当时是给我打了视频的,我在视频中也确认了面孔和声音,所以才放松了戒备。”郭先生事后说。

短短十分钟内,430 万不翼而飞!

好在确认被骗后,老郭在第一时间报了警,警方立刻联系银行快速响应,追踪并截停了那笔钱的走向,止损了其中的336万。

然而遗憾的是,即便警方已经如此给力,老郭仍然损失了近100万元。可见事后的补救再及时,也为时已晚。谁的钱也不是大风刮来的,老郭虽然是老板,但这笔钱对他和他的公司来说,也是一笔事关存亡的现金流。

其实也不能全怪老郭自己大意,毕竟又是老朋友,又是微信视频,谁会料到自己相识多年的老熟人,竟然是通过技术合成的假人呢?

据数据统计,遇上类似的套路,中招率几乎100%。可见,如今AI技术有多以假乱真。

AI诈骗手法

很明显,郭先生与何先生,都陷入了一场利用AI技术实施的诈骗。

骗子是先盗取了他们好友的微信,并收集了好友大量的图片、音视频信息,用以训练模型,最后通过AI实时渲染出的人物,来和他们微信视频,骗走钱财。

值得注意的是,骗子不是漫无目的地广撒网,而是别有用心地锁定诈骗对象。

他们会分析诈骗对象在网络平台发布的个人信息,根据所要实施的骗术利用AI技术对人群进行筛选,从而选出目标对象,制定诈骗计策。显然,郭先生就是被精心挑选出来的诈骗对象。

最恐怖的是,这种操作的门槛并不高。

CCTV记者找到一位提供人脸识别软件的卖家,人脸动作制作软件和教程售价仅为1299元。记者尝试后发现,AI制作出来的人脸,能通过90%的人脸检测App。

如果你遇上了,能够分辨出来吗?

除了AI换脸,AI技术还被用于以下几种诈骗方式。

第一种是声音合成,骗子通过骚扰电话录音等来提取某人声音,获取素材后进行声音合成,从而可以用伪造的声音骗过对方。

第二种是转发微信语音,在盗取微信号后,骗子便向其好友“借钱”,为取得对方的信任,他们会转发之前的语音,进而骗取钱款。尽管微信没有语音转发功能,但他们通过提取语音文件或安装非官方版本(插件),可实现语音转发。

此外,现在大家接到的骚扰电话、广告电话、诈骗电话,大多数都不是真人,而是AI了。

去年警察打掉的一个“推荐股票”的犯罪团伙,就是用AI设定好声音,然后无差别给人打电话。一天就能打数千个电话,这在以前得上百人的团队才能做到。

绝大多数人一听肯定就挂掉了,但只要基数够大,他们总能找到一些没有防备的“优质客户”,随后通过人工介入一步步诱骗,几年时间搞了1.8个亿。

每次新技术出来,永远是违法犯罪钻空子的先用上。

在AI技术越来越强大的今天,AI诈骗已经连年轻人都防不胜防,更别提老人了。赶紧提醒下家里的长辈,千万不要踩到这个雷。

AI造假已无处不在

AI技术是一把双刃剑,用好了,它能颠覆人类的生活。

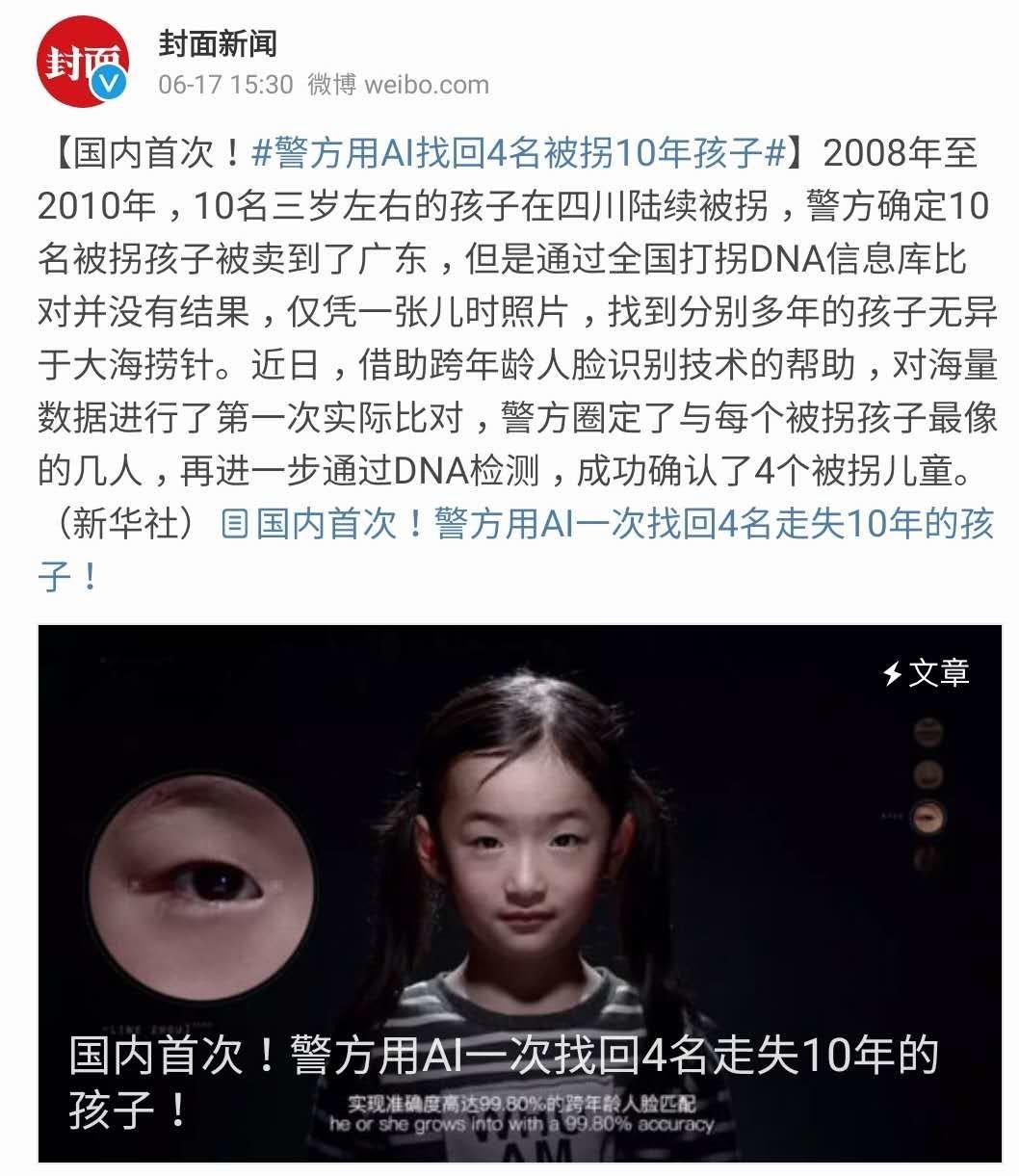

早在几年前,便有警方通过AI技术,找回了4名被拐长达10年的儿童,使用的仅仅是TA们一张儿时的照片。

也有公司使用AI技术,实现“一件穿衣”功能,让大家在网上购物时,也能拥有到试衣的体验。

而随着ChatGPT的诞生,AI在已经能在方方面面,提高人类的工作和生产效率,或许在未来,人类每月只用工作一个礼拜。

但同时,它也成为了骗子手中的利器,如今AI造假已无处不在。

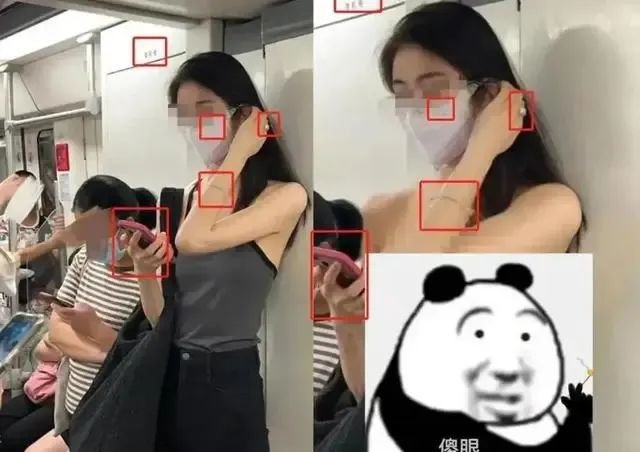

AI一键脱衣,几个月前一位广州的小姐姐就中招了。

此前,一张女子在广州地铁上的照片,被AI一键脱衣,造谣图随后在网上广泛传播。造谣者为了博人眼球,故意使用“广州地铁惊现裸女”等文案,一时间舆论沸沸扬扬。

事实上,照片的女生是一名穿搭博主,而所谓的“裸照”则是她去年7月在平台分享的一张照片。原图中她衣着正常,完全没有任何不妥之处,但却被有心之人用AI软件一键脱衣,然后故意全网散播,以通过流量获利。

一周前,几名“求交友”的陌生人发来照片,内容让周飞燕非常吃惊,一些淫秽不堪的女性图片里,长着与自己极其相似的脸。

首先涌来的是羞耻、愤怒,在揭开真相的过程中,她又逐渐感受到了焦虑和恐惧。

还有用AI换上明星的脸,然后带货的。

近日,有网友点开直播间,发现正在卖货的竟是当红女星,包括杨幂、迪丽热巴、angelababy等等。

然而定睛一看,这些带货“明星”很快露出了马脚——身穿中式服装,只是使用了AI实时换脸技术的普通主播。

AI从最初的“工业级”技术逐渐“飞入寻常百姓家”,更低的使用门槛和创作成本,给施害者,甚至不法分子提供了便利。

AI换脸诈骗、换明星脸直播卖货、换脸和明星“接吻”、乘地铁的照片被“脱衣”等案例层出不穷。

AI盗脸“造黄谣”“一键脱衣”也突破了法律和伦理界线,侵入普通人的生活。

唾手可得的制图工具和难以追溯的传播渠道,让AI“黄谣”制造者更加猖獗!

科技是用来造福人类的,让世界变得更美好才是科技发展的最终目的,如今的AI技术更应当如此。

加强对它的研究和监管,保护人们的隐私和尊严的权益,才能让数字化的生活变得更加美好、安全。

在这里,内参君再给大家提个醒:

骗子都会用技术武装自己,咱们更要提高警惕,仔细辨别多上点心。

年轻人可能稍微还好一些,对于一些上了年纪的家长来说,可能才刚刚学会视频通话,没想到就要面对这些牛鬼蛇神…

“福利姬”都有可能是假的,更别说突然在线上找你借钱的“朋友”了!

退一万步说,最平常的“朋友借钱”这回事,咱们还是约线下当面聊吧…