财联社资讯获悉,日前,AI科学家李飞飞团队与谷歌合作,推出了视频生成模型W.A.L.T(Window Attention Latent Transformer)——一个在共享潜在空间中训练图像和视频生成的、基于Transformer架构的扩散模型。从展示的案例来看,W.A.L.T的效果媲美Gen-2比肩Pika,其可以根据自然语言/图片提示生成逼真的2D/3D视频或动画。

一、AI视频生成领域进展不断

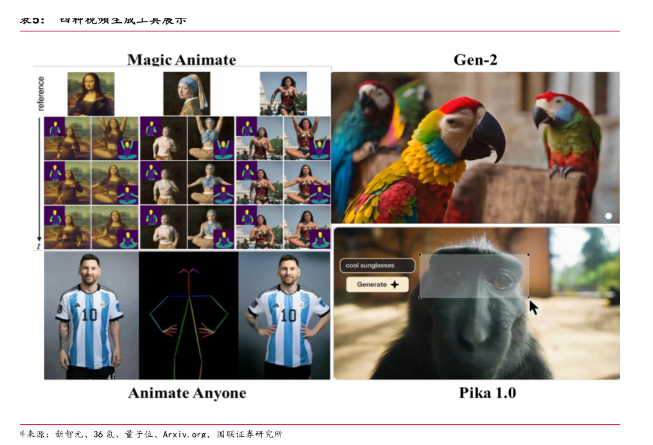

近期,AI视频生成领域进展不断,海内外多家企业先后推出相关AI视频生成工具或对原有的产品进行及时更新。国内看,11月27日和28日,字节和阿里相继发布了图生视频项目相关论文,阿里推出了AnimateAnyone,新加坡国立大学和字节跳动则联合推出了MagicAnimate。AnimateAnyone由阿里巴巴智能计算研究院开发,通过优化的扩散模型让静态任务生成动态视频,创作者只需提供静态的角色图像(包括真人、动漫/卡通角色等)和一些动作、姿势(比如跳舞、走路)即可将其动画化,同时保留角色的细节特征(如面部表情、服装细节等)。MagicAnimate是新加坡国立大学和字节跳动联合推出的“人体图像动画生成器”,能够把指定的人物图片按照既定动作序列生成视频。

国外看,11月20日,Runway更新其视频生成模型Gen-2,上线“运动画笔”功能。11月22日,此前发布标志性文生图模型StableD-iffusion的公司StabilityAI推出最新AI模型StableVideoDiffusion,实现图片生成视频。11月28日,美国AI初创公司Pika发布的AI生成视频工具Pika1.0火热出圈,其主要功能包括文本/图片生成视频、内容编辑、风格转化、尺寸调整等。

二、多模态大模型是未来发展趋势

上海证券刘京昭分析指出,具备文生视频功能的视频类生成式AI在领域,能够有效降低创作者的创作门槛,提高创作效率,在游戏、广告等领域有其独特的优势。后续随着算力设施的进一步建设和视频类生成式AI模型的完善,有望在视频领域出现新的现象级应用,推动生成式AI的持续发展。

上海证券陈旻进一步表示,多模态大模型是未来发展趋势。相较于文字和图片,视频在信息表达、画面丰富性及动态性方面有更大优势,视频可以结合文本、图像、声音及视觉效果,在单一媒体中融合多种信息形式。通过文本描述或其他简单操作,AI视频工具即可生成较高质量和完成度视频内容,这降低了视频创作门槛,让创作者能够精准用视频进行内容展现,有望广泛赋能各细分行业的内容生产降本增效和创意输出,进而开拓出更广阔的应用场景。

三、相关上市公司:万兴科技、昆仑万维、当虹科技

万兴科技表示,万兴播爆/Virbo是公司打造的一款面向全球在线营销、跨境电商及直播领域用户的AIGC数字人营销短视频创作和直播软件,内置180多款数字人形象、上百套视频模板、10万+资源素材,以及120+语种配音,不仅支持一键切换虚拟人、场景、声音和语种,帮助用户快速生成海量营销视频,还支持数字人直播、直播推流、实时互动、AI智能脚本、AI翻译等功能。

昆仑万维表示,旗下Star Group和Opera都具备做短视频的土壤,其中Opera在海外已经推出了短视频功能。日前,昆仑万维天工大模型在腾讯优图实验室联合厦门大学开展的多模态大语言模型测评中,综合得分排名第一。

当虹科技拥有自研的AIGC工具集,于今年上半年发布了以静态照片生成三维体积视频的方案。