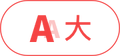

英伟达正式宣布,下一代AI数据中心平台Vera Rubin的首批样品,已经送到客户手里了。在本周的财报电话会议上,英伟达CFO科莱特・克雷斯亲自确认了这件事:首批Vera Rubin样品,本周早些时候就已经交付完成。

部署时间预计在2026年下半年,最晚也不会超过2027年初。这也就意味着,Vera Rubin的性能、功耗这些关键指标用不了多久就能和大家正式见面。

图片来源:法新社

作为专为超大规模AI训练打造的全新平台,Vera Rubin的硬件规格相当亮眼。整套系统搭载88核Vera CPU,并配备Rubin GPU。单颗Rubin GPU最高可搭载288GB HBM4高带宽内存,搭载128GB GDDR7的Rubin CPX GPU。除此之外,平台还集成了NVLink6.0交换芯片、BlueField‑4 DPU、新一代光子以太网和高速智能网卡等全套组件,相当于一套从头到脚都拉满配置的完整方案。

图片来源:英伟达

为了让合作伙伴更快落地,英伟达做了不少优化。不同的合作伙伴,会拿到不同的组件;有的客户更省心,甚至能直接收到集成了所有硬件的NVL72 VR200整机机架。像富士康、广达、超微、纬创这些我们熟悉的服务器大厂,也都拿到了芯片样品,已经开始着手做整机开发。

英伟达还准备了预装CPU、GPU、散热和接口的计算托盘,工程团队大包大揽了属于是。

图片来源:推特

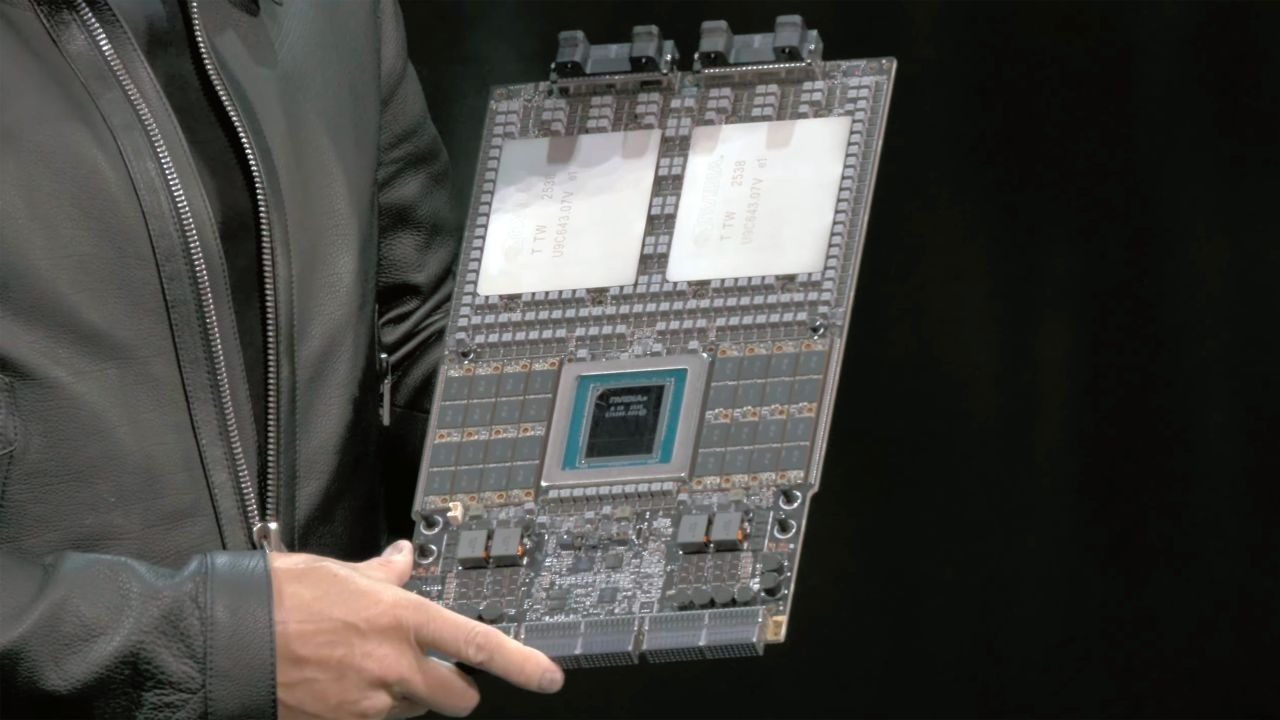

和上一代 Blackwell 系统比起来,Vera Rubin在设计上聪明了很多。它采用模块化、无线缆的托盘结构,芯片可以快速插拔,几秒钟就能完成更换。英伟达直言,新机架的可靠性和易用性都会明显提升。

如果把整机拆开看,你会更直观感受到它的 “夸张”。一台机架里就有72个Rubin GPU+ 36个Vera CPU,整机零部件总数高达130万个,芯片数量从上一代的864个增加到1300个,整机重量接近2吨。英伟达称,在特定AI训练场景下,其每瓦性能相比上一代Grace Blackwell最高可提升至10倍。虽然新系统耗电量将是前代的两倍,但能效提升非常显著。

图片来源:newstecnicas

它也是英伟达首个全面采用液冷设计的系统平台。相比传统散热更省水,对大型数据中心非常友好。这些核心芯片主要由台积电生产,整机的零部件来自全球20个国家、80多家供应商,供应链覆盖中国、美国、墨西哥、越南等地,算得上是真正的世界级工程。

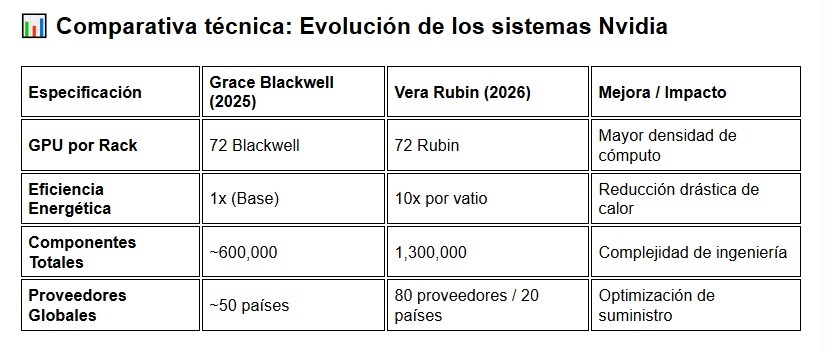

目前,Vera Rubin正在推进量产。Meta表示,计划在未来数据中心建设中采用Rubin架构。除此之外,OpenAI、Anthropic、亚马逊、谷歌、微软等科技巨头,也都是它的潜在客户。

图片来源:推特

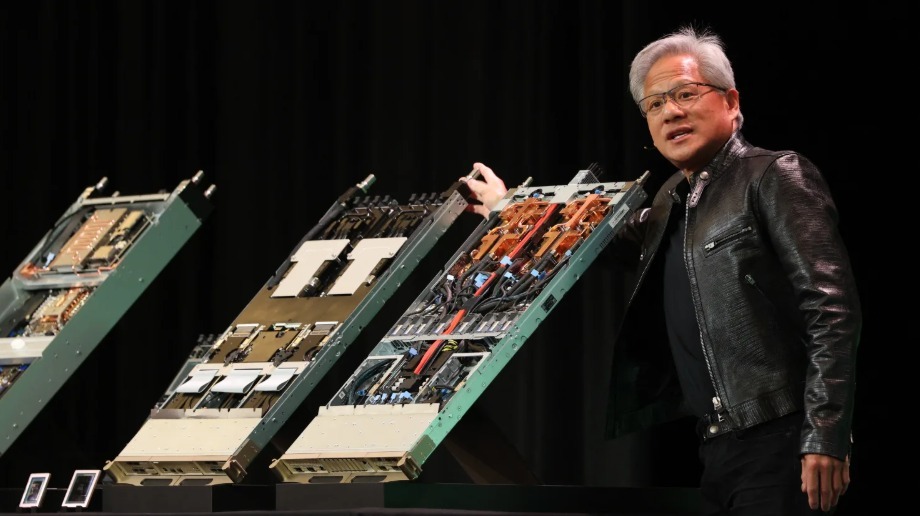

至于大家最关心的价格,英伟达暂时没有公开。但行业机构Futurum Group预估,单台机架的价格会比上一代上涨约25%,大概在350万到400万美元之间。

图片来源:CNBC

当然,一路高歌的英伟达也不是没有挑战。全球AI热潮让内存供不应求,成本一路上涨;AMD即将推出对标Vera Rubin的产品Helios,而且已经拿到了Meta的大订单;亚马逊、谷歌也在大力推广自家研发的AI芯片,越来越多客户开始选择多供应商路线,不再只依赖英伟达。但无论如何,随着Vera Rubin首批样品交付,英伟达似乎还会继续领跑算力硬件这条赛道。