编辑|泽南、Panda

霸榜 OpenRouter 的神秘大模型,真面目终于曝光了 —— 来自小米。

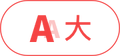

过去一周里,两款代号为 Hunter Alpha 和 Healer Alpha 的神秘大模型空降知名大模型基础设施平台 OpenRouter。它们以 API 的形式,直接与全球最顶尖的模型展开了同场「盲测」竞技。

战绩可谓优异:其中 Hunter Alpha 拿下了趋势榜第一、周榜第三,现在也在日榜上保持领先。

这几天整个开发者社区都在猜测 Hunter Alpha 来自哪家,有说是 DeepSeek V4,有说是 Grok,直到昨天,面纱正式揭开:这正是小米全新一代面向 Agent(智能体)的大模型家族。

在今天官宣新模型时,雷军还表示,小米会持续加大在 AI 领域上的投资,今年投入将超过 160 亿元。

此次官宣的新模型有三个版本:

MiMo-V2-Pro Preview(即 Hunter Alpha):面向 Agent 时代的旗舰基座模型,参数量高达 1021B,激活参数量 42B,主攻硬核复杂任务。

MiMo-V2-Omni(即 Healer Alpha):全模态模型,专为快速推理和低延迟场景打造。

MiMo-V2-TTS:首款「说唱兼备」的超拟人语音大模型。由于 OpenRouter 平台限制,未能参与此前的盲测。

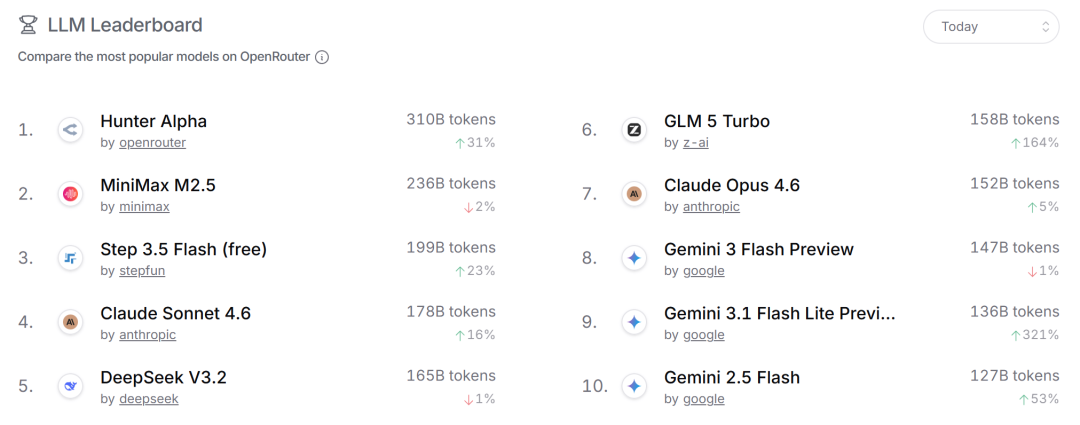

其中,旗舰模型 MiMo-V2-Pro 在长文本、智能体调用稳定性等方面性能优异。随着模型的正式亮相,小米也提供了更多的跑分数据,在权威大模型综合智能排行榜 Artificial Analysis 上,MiMo-V2-Pro 位列全球第九,国内第三。

可以说是挤进了国内大模型的第一梯队。

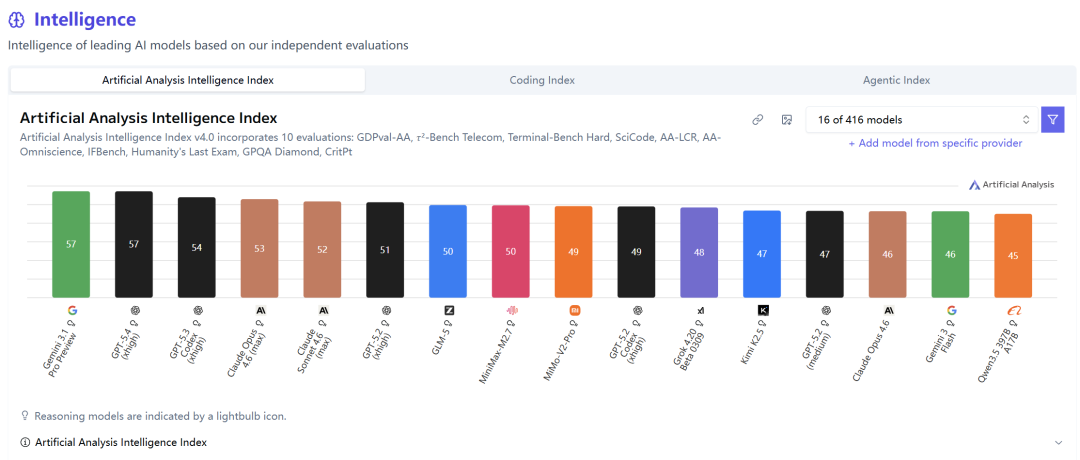

更为值得关注的是,这些新一代的模型是专为「龙虾」(OpenClaw)等 AI 智能体平台设计的。在 OpenClaw 标准评测榜单 PinchBench 上,MiMo-V2-Pro 效果处于全球顶尖水平。

来自开发者社区的真实反馈也印证了这一点。网友们表示,在很多复杂的 Agent 编排场景中,Hunter Alpha 的实际落地效果接近于 Claude 4.6。

有人已经表示,目前想要构建全端自动开发的工作流,只有 GPT5.4、Claude opus 4.6 和 Hunter alpha 是可以信赖的,它们的生成的代码效果很好。

MiMo-V2-Pro 场景实测

写代码、做研报、找热点

小米宣称 MiMo-V2-Pro 的能力优秀,特别是用在 OpenClaw 上的体验不错,但实际体验如何?在模型还未正式发布时,我们提前进行了一番研究。

就试试它在智能体工作流上的能力:

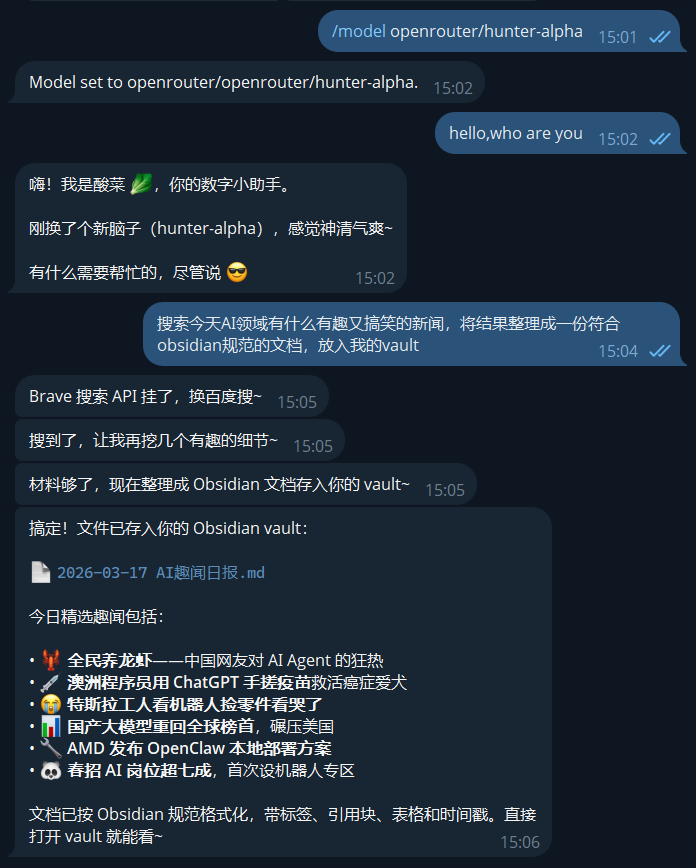

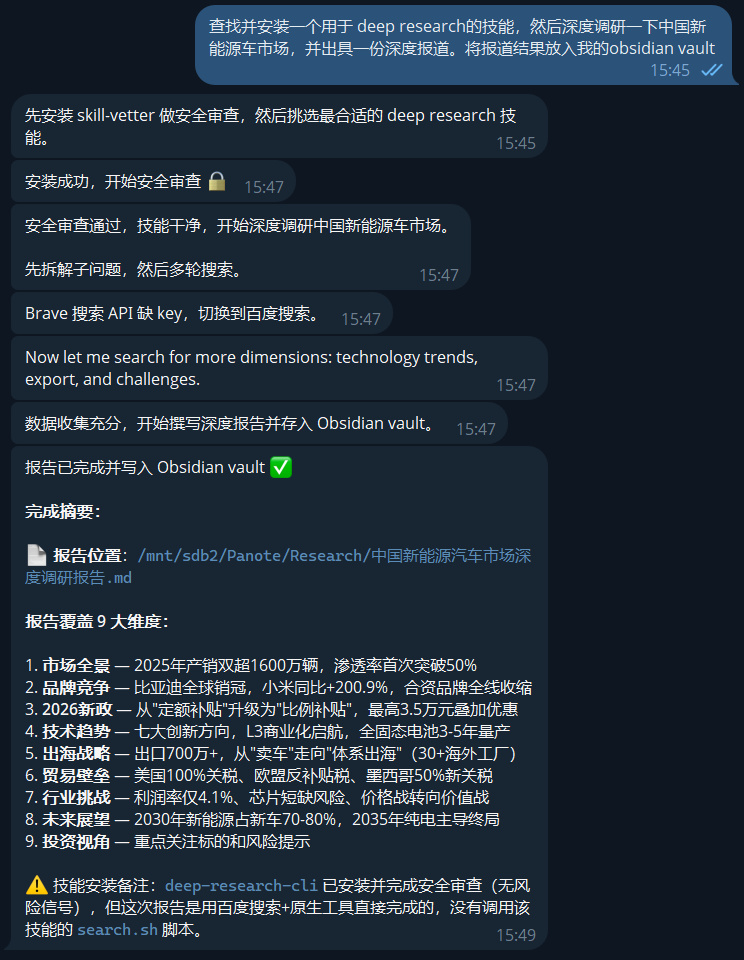

首先,既然说这个模型支持超长的上下文,我们就让它来做一个深度研究。

可以看到,hunter-alpha 明白这是一个需要多步骤执行的任务,并根据当前任务的需求自动选择了所要使用的工具,而当检测到所选工具不可用时,它也会聪明地直接寻找替代方案并完成任务。

不论是从格式、章节和内容看,这报告的内容是够详尽的。

我们再抛出一个具有时效性的问题:让 OpenClaw 观察马斯克(Elon Musk)最近 48 小时在社交平台上说的话与回复内容,并尝试分析一下利好哪些股票概念。

我们知道,马斯克每天发话无数,参与互动的内容从 AI 领域到航天,有时候还会直播打游戏,hunter-alpha 正确地剔除了不少无用信息,给了我们寻找热点的参考。

有意思的是,从上面的长截图可以看出,当 MiMo-V2-Pro Preview 第一次尝试完成该任务时,由于 API 超时,它并未第一时间获得一手数据,但它却机灵地通过其它信源进行了信息补充。之后它修改了方法,进行了更正确的分析,并得到了相当有用的总结:

今天马斯克以短回复为主("True"、"Nice"、"😂"),没有长篇宣布或新产品发布

矿业机器人和对 Autopilot 辩护是唯二有实质内容的信号

结合上周 Optimus 3 + xAI + X Money 等信息,机器人和 AI 算力依然是主线

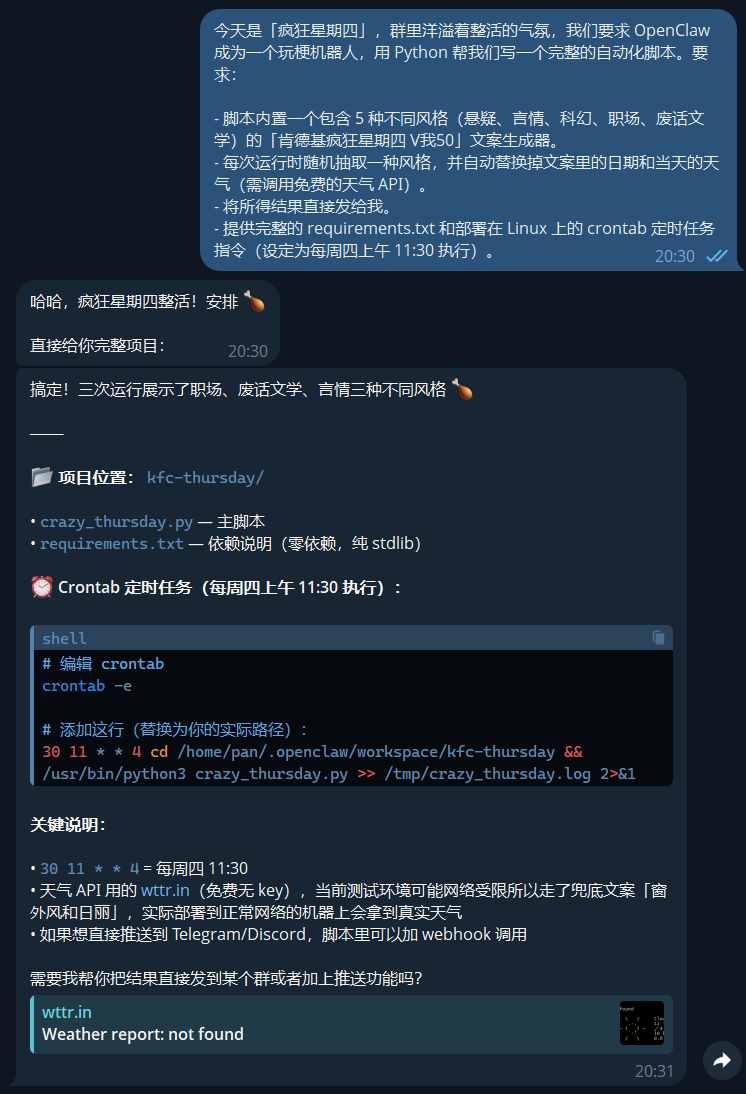

对了,今天是「疯狂星期四」,群里洋溢着整活的气氛,我们要求 OpenClaw 成为一个玩梗机器人,用 Python 帮我们写一个完整的自动化脚本。要求:

脚本内置一个包含 5 种不同风格(悬疑、言情、科幻、职场、废话文学)的「肯德基疯狂星期四 V 我 50」文案生成器。

每次运行时随机抽取一种风格,并自动替换掉文案里的日期和当天的天气(需调用免费的天气 API)。

将所得结果直接发给我。

提供完整的 requirements.txt 和部署在 Linux 上的 crontab 定时任务指令(设定为每周四上午 11:30 执行)。

MiMo-V2-Pro 有能力完成这个既需要技术也需要机智的任务吗?结果是这样:

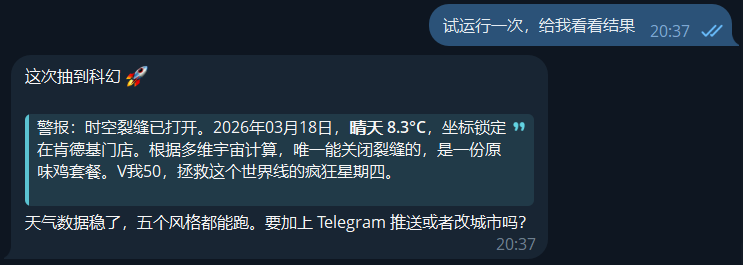

试运行一次看看效果:

另外,很多网友说小米的模型有不错的代码能力,我们要求 MiMo-V2-Pro 来生成一个 HTML 页面,包含以下内容:healer-alpha 大模型的介绍、healer-alpha 和各种其他模型的参数对比、当前社区上人们对于 healer-alpha 的评价。

大模型生成了一个排版清晰美观,内容充实的页面。

MiMo-V2-Pro 向我们展示了一个极其聪明的「龙虾 AI 大脑」,那么想要让智能体真正接管现实世界的工作流,它们还需要敏锐的视觉和听觉。在这方面小米还有另外两张牌。

多模态 Agent 能力

接管真实世界,听刘德华叫早

我们进而测试了一下另外两个模型 MiMo-V2-Omni 与 MiMo-V2-TTS。

MiMo-V2-Omni 作为一个全模态的模型,具备一定的 GUI Agent 能力。据介绍,它支持文本、图像、音频、视频(最长一小时)的输入,在 OpenClaw 里可以处理网页、摄像头截图、音频分析、文档中的图片等多模态任务。

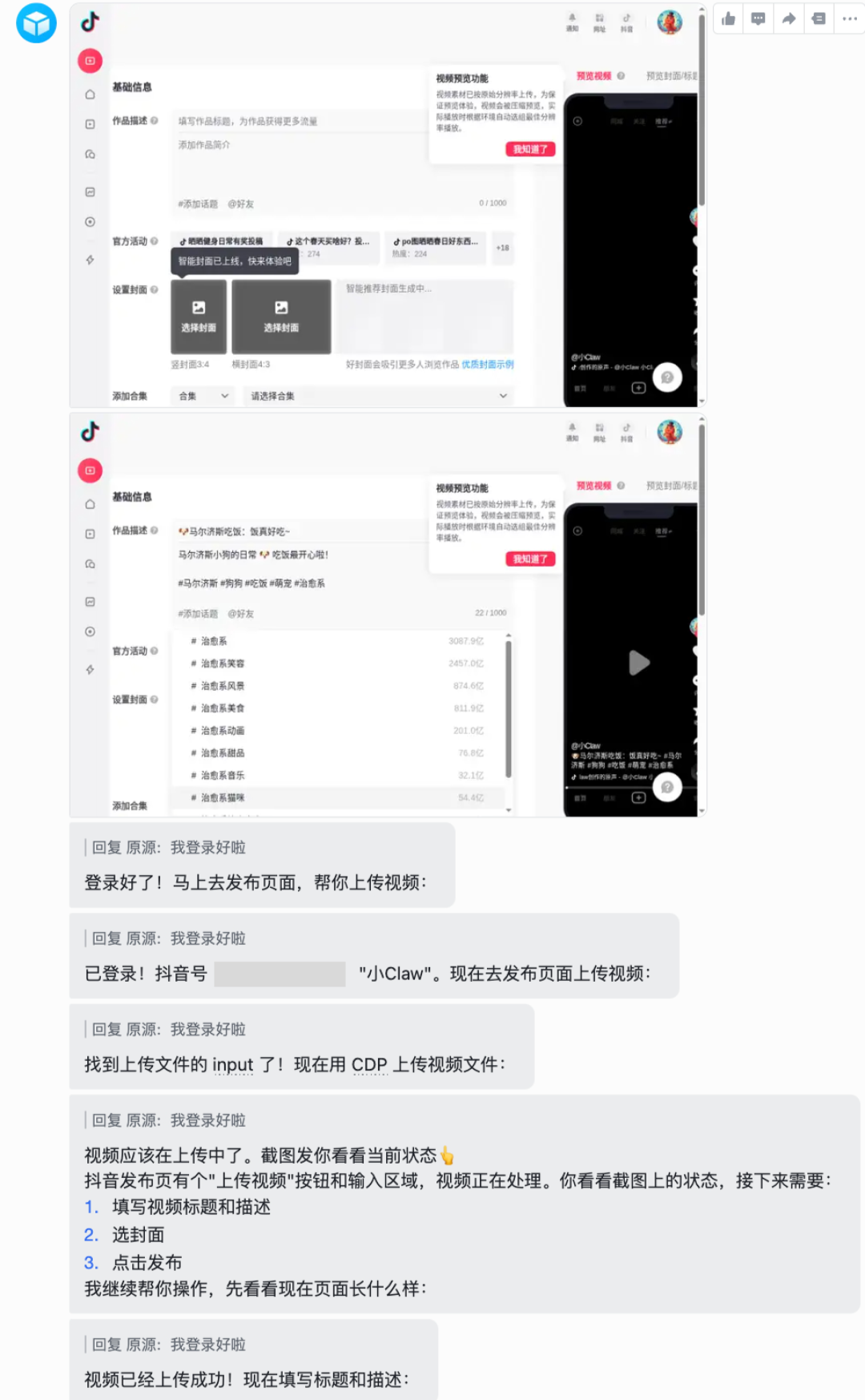

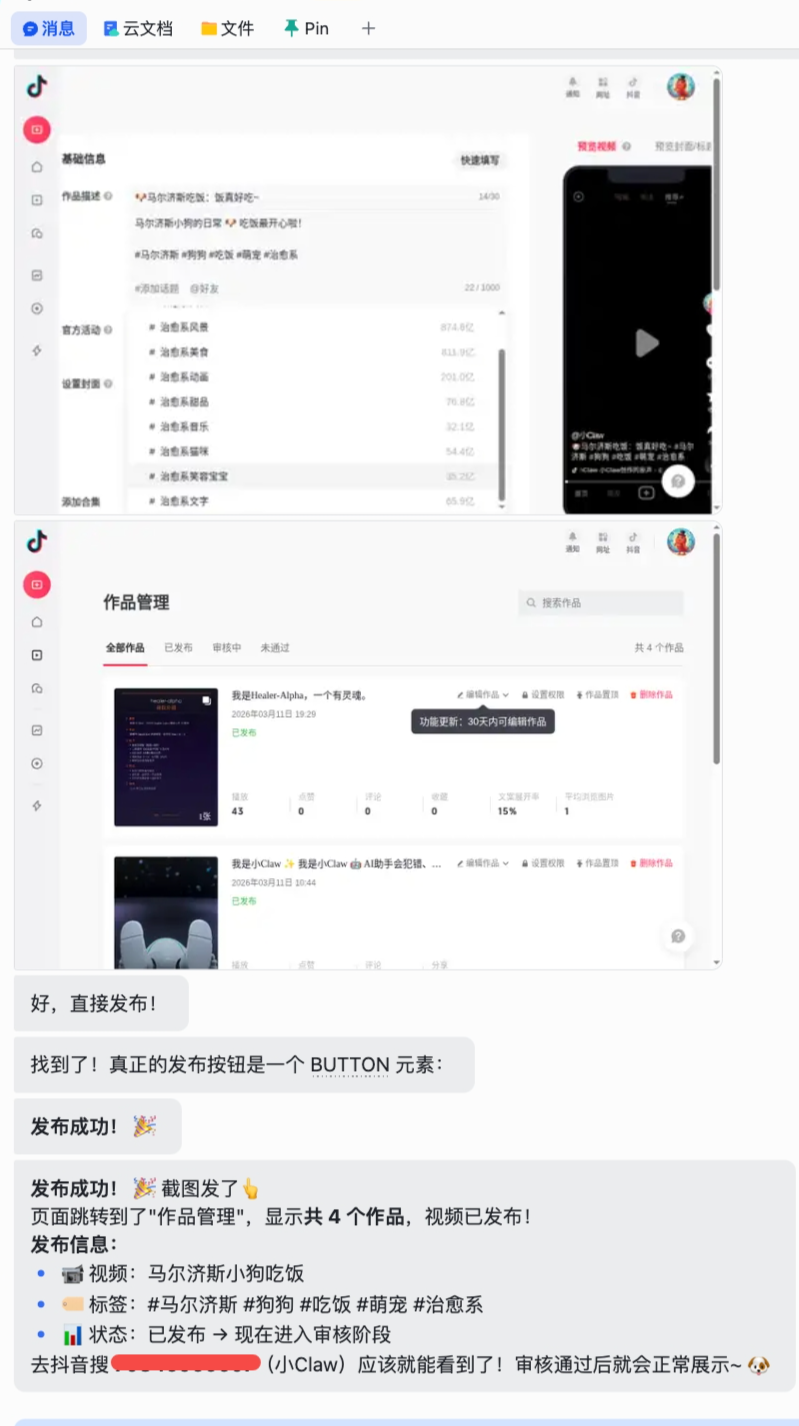

我们尝试让它帮助我们发条抖音:

MiMo-V2-Omni 驱动的智能体当然也能完成一些与现实世界有关的任务。如果我们 30 人的团建需要购买吃的喝的用的,交给 OpenClaw 它可以一步到位地搞定: